Weekly Commits #2 - Shopify, Muon Optimizer, GLP-1, OpenAI, 샘 올트먼

Shopify, Muon Optimizer, GLP-1, OpenAI, 샘 올트먼

Weekly Commits은 한 주에 보았던 아티클, 정보를 한 곳에 모아서 왜 흥미로운지에 대한 관점을 담아 소개한다.

(1) Shopify가 회사 내부에 AI를 도입한 방법

Using AI effectively is now a fundamental expectation of everyone at Shopify. It's a tool of all trades today, and will only grow in importance. Frankly, I don't think it's feasible to opt out of learning the skill of applying AI in your craft; you are welcome to try, but I want to be honest I cannot see this working out today, and definitely not tomorrow. Stagnation is almost certain, and stagnation is slow-motion failure. If you're not climbing, you're sliding.

이제 AI를 효과적으로 사용하는 것은 Shopify의 모든 구성원에게 기대되는 기본적인 사항입니다. AI는 오늘날 모든 분야에서 쓰이는 도구이며, 앞으로 그 중요성은 더욱 커질 것입니다. 솔직히 말씀드리자면, 저는 여러분이 각자의 업무에 AI 활용 기술을 배우지 않고 버틸 수 있다고 생각하지 않습니다. 시도해 보는 것은 자유지만, 솔직하게 말해서 오늘날은 물론 내일은 더욱더 통하지 않을 것입니다. 정체는 실패로 가는 서서한 움직임이며, 정체하는 순간 거의 확실히 뒤처집니다. 올라가지 않으면 미끄러져 내려가는 것입니다.

2025년 4월, Shopify의 CEO, Tobi Lutke가 AI 사용을 필수라고 선언하면서 큰 파장이 있었다. 이에 Shopify의 엔지니어링 부사장, Farhan Thawar가 Shopify 내부에는 어떤 일이 있었는지 정리했다.

AI를 사용하면 비용이 발생한다. 더 좋은 AI를 사용하기 위해서는 더 많은 비용이 발생한다. Shopify 내부에서도 Cursor와 같은 AI 도입으로 너무 많은 비용이 들거라는 우려가 있었다. 가장 좋은 AI를 이용하고 제한 없이 AI를 이용하면 인당 $1,000~$10,000의 추가 비용이 들 수 있기 때문이다.

이때 Thawar는 AI로 가치를 얻을 수 있다면 AI를 사용해야 한다고 판단했다. Thawar는 Shopify 내부에 AI 토큰 사용 순위표를 만들고 이 순위표 안에 드는 것을 자랑스러워하게 만들었다.

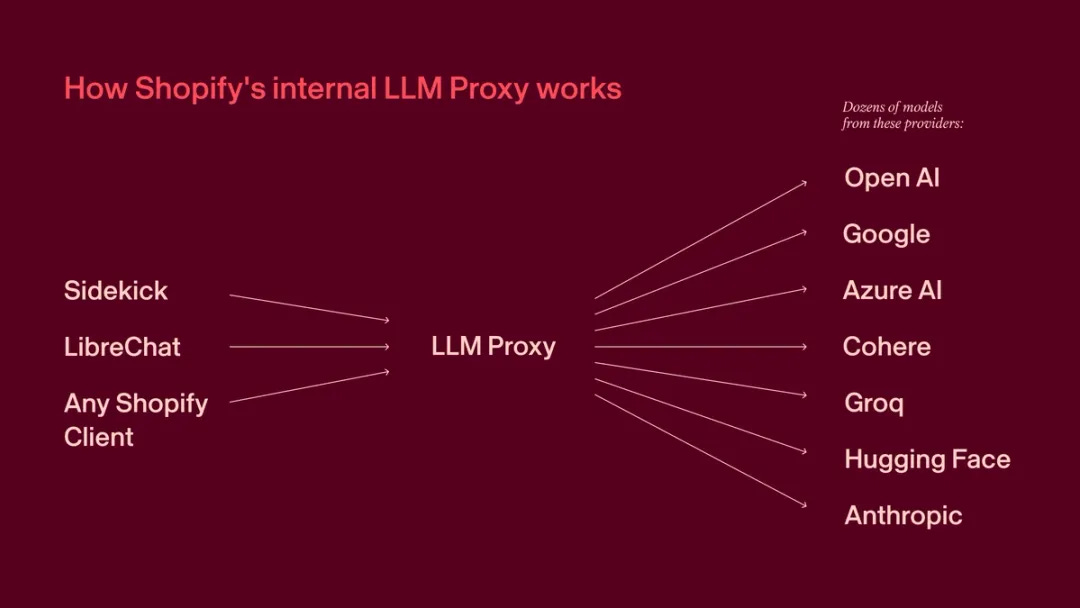

또한, Shopify는 MCP를 활용해 회사 내부에 모든 툴을 연결했고, 내부 LLM Proxy를 만들어 다양한 모델에 쉽게 상호작용하고 변경할 수 있도록 만들었다.(상황 별, 최신의 AI 모델을 더 빠르게 사용하기 위한 노력)

이 MCP와 LLM Proxy를 이용해 업무 워크플로우를 가속화 해냈다.

영업 엔지니어는 MCP로 Google Drive, Slack, Salfesforce등 자주 사용하는 툴을 연결해 “오늘 뭘해야 할까?”라고 질문하면 무엇을 해야할지 알려주는 워크플로우를 만들었다.

Revenue Tooling 팀은 수주를 위해 외부에서 질문(RFP, 제안 요청서)이 들어오면 이를 내부 문서를 기반으로 답변을 생성할 수 있는 AI 챗봇을 만들었다. 이 챗봇의 가장 큰 장점은 수주까지 이어진 답변을 학습하여 더 좋은 답변을 하도록 만들었다는 점이다.

AI가 기존에 작성된 코드를 로스팅하게 만들어서, 더 좋은 코드를 작성할 수 있게 도왔다.

Shopify에서 AI를 도입한 모습은, 2002년 아마존 제프 베조스의 API 강제 명령 처럼 느껴지기도 한다.

1/ 모든 팀은 앞으로 데이터와 기능을 서비스 인터페이스를 통해 공개해야 합니다.

2/ 팀 간 소통은 반드시 이 인터페이스를 통해서만 이루어져야 합니다.

3/ 다른 형태의 프로세스 간 통신은 일체 허용되지 않습니다. 직접 연결, 다른 팀의 데이터 저장소 직접 읽기, 공유 메모리 모델, 백도어 등은 전부 금지됩니다. 허용되는 유일한 통신 방식은 네트워크를 통한 서비스 인터페이스 호출뿐입니다.

4/ 어떤 기술을 사용하든 상관없습니다. HTTP, CORBA, Pub/Sub, 커스텀 프로토콜 등 모두 가능합니다. Bezos는 기술 선택에 신경 쓰지 않습니다.

5/ 예외 없이 모든 서비스 인터페이스는 처음부터 외부에 공개 가능하도록 설계되어야 합니다. 즉, 팀은 외부 개발자에게 인터페이스를 노출할 수 있도록 기획하고 설계해야 합니다. 예외는 없습니다.

6/ 이를 지키지 않는 사람은 해고됩니다.

Shopify의 다음 스탭이 기대된다. 내부에 AI 도입을 늘리는 행위는 어떤 경쟁력까지 만들어 낼 수 있을까?

(2) Muon Optimizer의 대규모 훈련이 가능하다는 것을 증명

딥러닝 모델에서 Optimizer(최적화 알고리즘)은 AdamW 이후로 큰 발전이 없었다. Optimizer를 변경하는 것은 막대한 검증 비용이 발생하고, AdamW가 딥러닝 학습에 있어서 대부분의 요구를 충족할 수 있기 때문이다. 그래서 최근 나온 대부분의 Optimizer는 AdamW를 일부 변형한 것에 불과하다.

그런데 2024년 12월, OpenAI의 Keller jordan이 CIFAR-10(컴퓨터 비전 알고리즘 데이터셋) 스피드런에서 3초의 벽을 깨고자 새로운 Optimizer 모델인 Muon을 공개했다. Keller jordan은 Muon Optimizer을 이용해 CIFAR-10 스피드런에서 2.59초를 달성해냈다.

다만 Muon이 NanoGPT의 훈련 속도를 줄이거나, CIFAR-10의 학습 스피드런에만 치중되어 있어서 AdamW 처럼 큰 모델에서도 적용 가능한지에 대한 의문이 존재하는 상황이었다.

이에 중국의 Moonshot AI는 2025년 2월, Muon Optimizer의 성능을 증명하는 오픈 소스 모델 Moonlight를 출시했고, Muon Optimizer로 대규모 학습을 하기 위해서는 Weight Decay가 필요하다는 것을 알게 된다.

그런데 1,000억 개 이상의 매개변수를 가진 모델을 Muon으로 학습하려고 하면 Weight Decay를 이용하더라도 Attenion Logit이 엄청나게 커지는 문제를 겪었다. 그래서 GPT-4.1, Claude 4 Opus 만큼 큰 AI 모델을 Muon Optimizer를 이용하여 만드는 것이 불가능 했다.

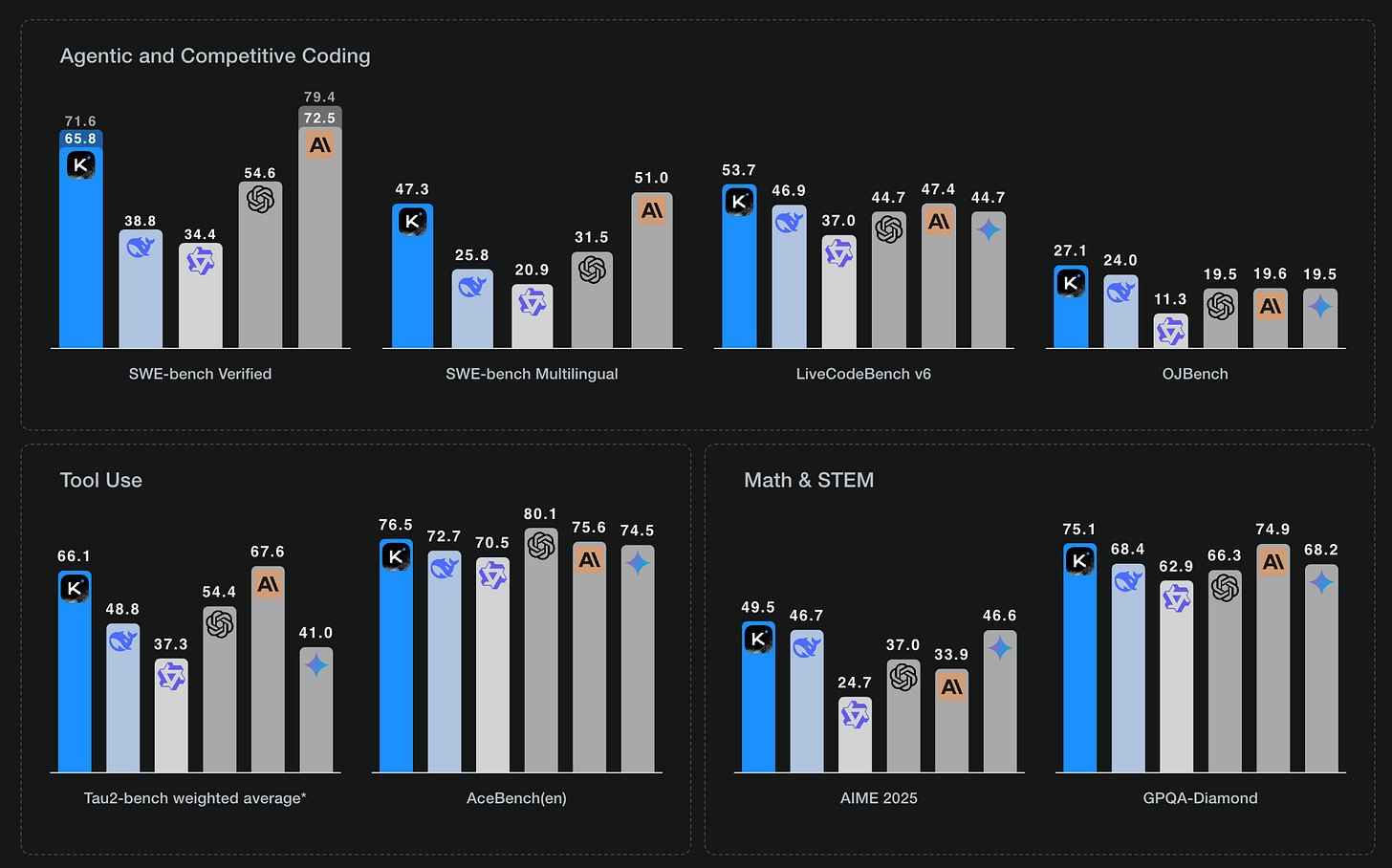

2025년 7월, Moonshot AI는 결국 Attention Logit을 제어하는 QK-Clip 방식을 제안하며, Attention logit이 엄청나게 커지는 문제를 해결해냈다. 이와 함께 Muon Optimizer를 이용해 학습한 오픈소스 AI 모델인 Kimi K2를 공개했는데, Kimi K2는 320억 개의 활성화된 매개변수, 1조 개의 총 매개변수를 학습한 AI 모델이었다.

Kimi K2는 코딩 벤치마크에서 GPT-4.1 및 Claud 4 Opus 모델을 능가하는 성과를 보여주었다. Kimi K2와 QK-Clip은 Muon Optimzier가 대규모 학습이 가능하다는 것을 증명했고, Muon으로 학습한 AI 모델이 프론티어 AI 모델만큼의 성능이 나왔다는 것을 보여주었기에 의미가 있다. 딥러닝 Optimizer의 패러다임이 바뀔지도 모르는 순간이다.

(3) GLP-1(위고비)가 생명보험을 파괴하고 있다

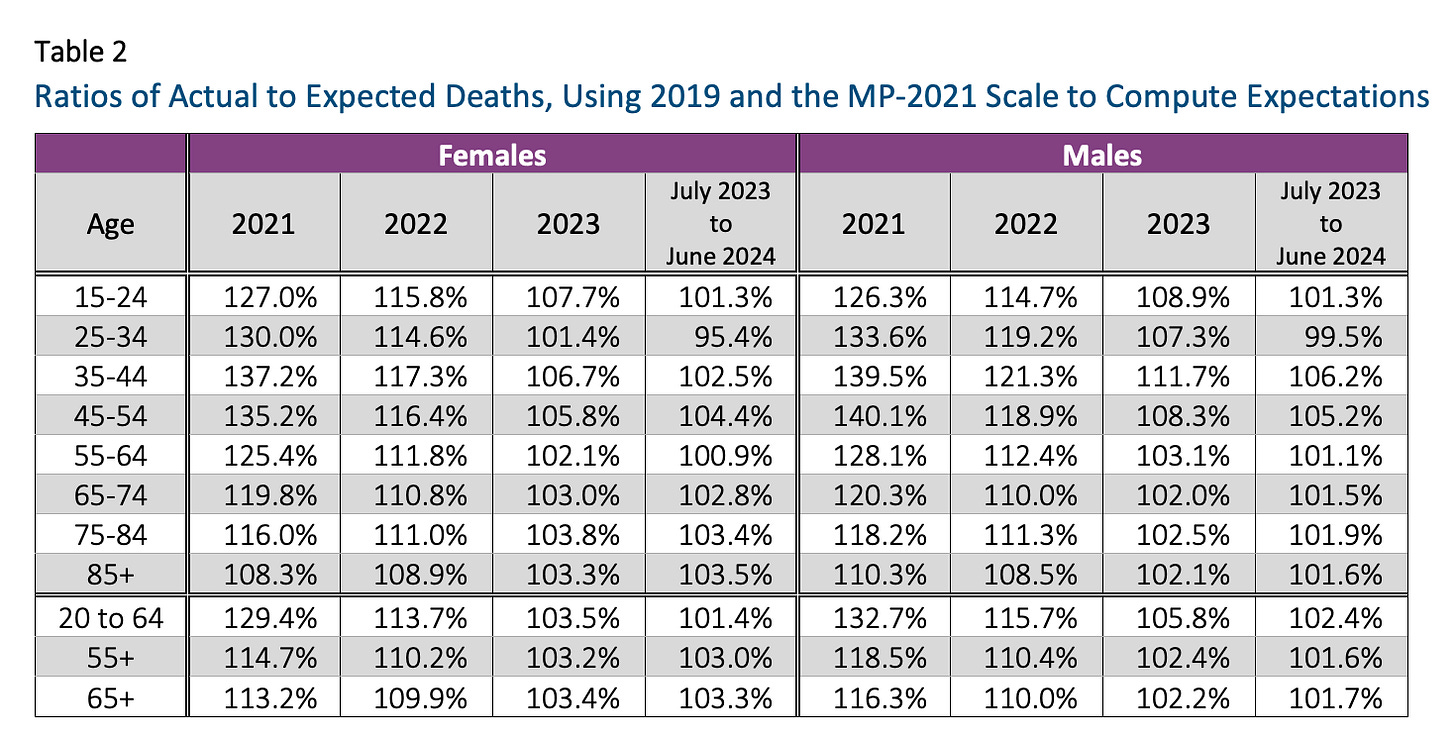

미국의 생명보험사는 98%의 정확도로 사람이 언제 죽을지 예측할 수 있다.

이때 보험사들은 HbA1c, 콜레스테롤, 혈압, BMI와 같은 주요 건강 지표를 사용하여 보험비를 측정한다.

그런데 최근 들어서 생기는 문제는 HbA1c, 콜레스테롤, 혈압, BMI가 GLP-1(위고비) 투여를 통해 상당부분 개선할 수 있다는 점이다.

GLP-1 투여가 생명보험사에게 문제로 다가오는 이유는, GLP-1 투여를 중단하고 2년이 흐르면 BMI, 혈압, 콜레스트롤 같은 주요 지표들이 처음 상태로 회복되는데에 있다. GLP-1을 투약한 상태에서 생명보험 심사를 받고, GLP-1 투약을 중단해 생명 보험사의 예상에서는 건강해야 할 사람들이 병에 걸리고 죽어버리니 보험사가 고생 중이다.

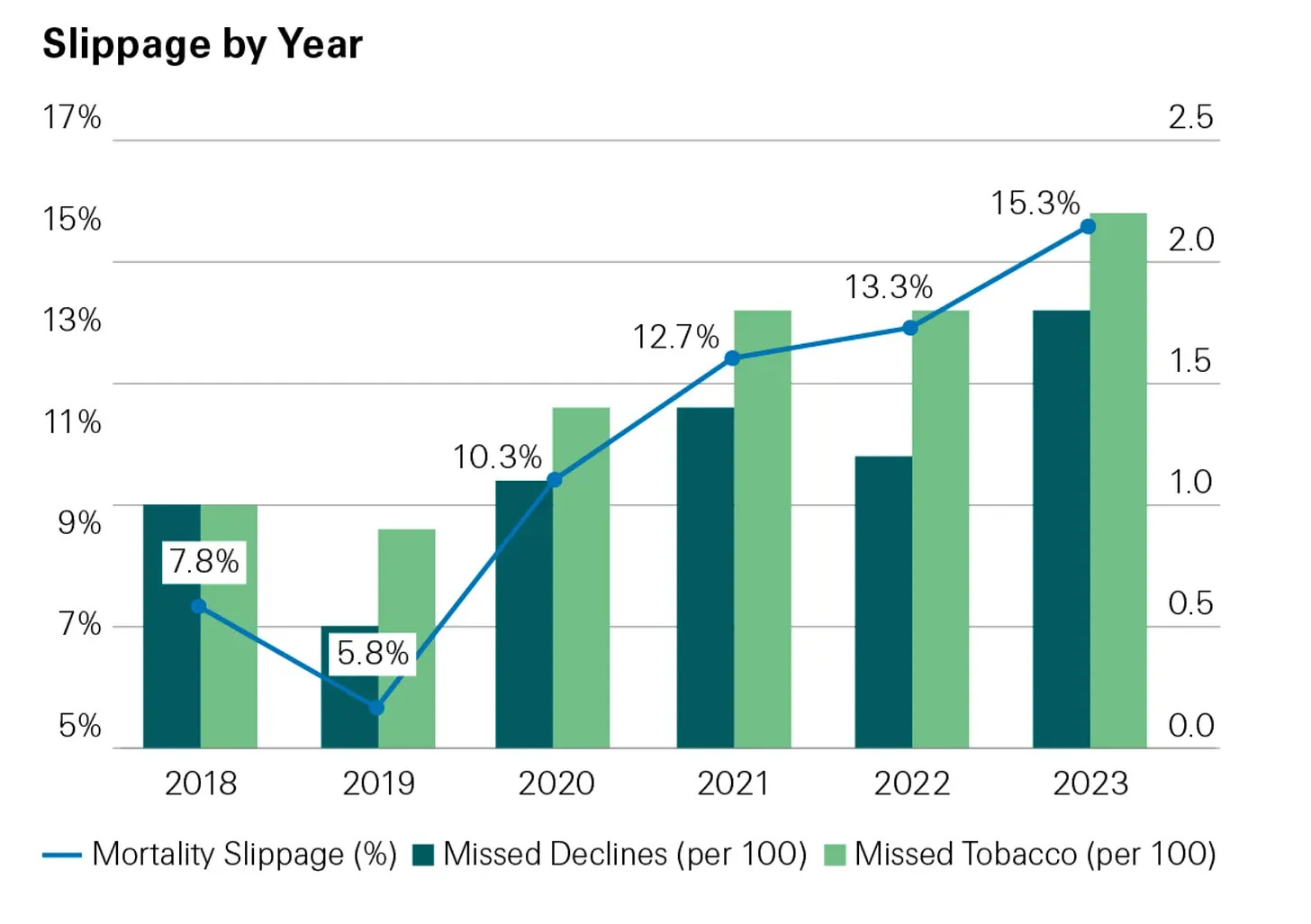

실제로 보험 가입자의 건강 상태를 발견하지 못해 계약 거절이나 요금 인상을 놓친 Miss Declines(진한 초록색 막대)가 지속적으로 증가하고 있다.

이 문제 해결하기 위해 보험사에서 GLP-1의 보험비를 지원해주는 아이디어가 떠올랐다. GLP-1의 지속적인 복용으로 BMI, 혈압, 콜레스트롤이 줄어들어 보험 가입자들이 오래 살아남는다면 보험사에게 더 큰 매출을 가져올 수 있을 것이다.

(4) OpenAI 퇴사록

전직 OpenAI 직원 Calvin이 공개한 퇴사 회고가 화제다. 그는 OpenAI의 조직 문화를 “로스앨러모스(핵 연구소) + 초대형 소비자 서비스”의 결합으로 비유한다.

OpenAI의 공식 로드맵은 사실상 비어 있고, 아이디어가 나오면 사람이 붙어 팀이 생긴다.

같은 문제를 여러 팀이 동시에 다른 방식으로 파는 병렬 실험을 ‘낭비’가 아닌 학습 속도를 위한 비용으로 받아들인다.

연구자들은 각자 ‘미니 CEO’처럼 자기 주제를 골라 밀어붙인다.

의외인 점은 내부 커뮤니케이션이 단단히 정렬되어 있지 않다는 것이다. 대부분의 소통이 Slack에 흩어져 있고, 일부 신규 제품이나 방향 전환은 막판까지 소수만 알고 진행되기도 한다.

어떤 소식은 내부 공지보다 외부 기사나 SNS로 먼저 돈다.

“이 회사는 트위터 분위기로 돌아간다”는 말이 나올 정도로 소셜미디어에 진심이다.

기술과 모델은 빠르게 외부에 풀지만, 매출·성과·유닛이코노믹스 같은 핵심 숫자는 극소수만 보는 “열린 기술 vs 닫힌 숫자” 구조다.

엔지니어링은 거대한 파이썬 모노레포 위에 Rust와 Go가 얹히는 과도기 형태이며, 스타일 불균일, 중복 라이브러리, 깨지는 CI 같은 ‘확장 부작용’을 정리 중이라고 한다.

보안에 철저하기로 유명한 OpenAI에서 이 정도 이야기가 나온 것은 처음이라 걱정되기도 하지만 재미있다.

(5) 샘올트먼, 더 비전 2030

샘 올트먼이 그려놓은 미래의 청사진은 정교하면서도 야심차다. 밑그림만으로도 우리는 새로운 시대에 대한 기대와 상상을 품게 된다.

이 책은 현재 대외적으로 알려진 올트먼의 계획들—OpenAI, UBD, 기본소득, 월드코인 등—을 한데 묶어, 그가 왜 이런 프로젝트들을 추진하는지 그의 과거와 사상을 통해 설명한다. 특히 YC 시절부터 투자한 회사들을 사례로 들며, 왜 해당 기업에 (심지어 개인 돈까지 써가며) 베팅했는지 납득이 가는 시나리오를 보여준다.

하지만 올트먼의 비전은 너무 거대하고 복잡하며, 기술 만능주의에 대한 비판을 피해갈 수 없다. 그는 아직 통제가 어려운 AGI, 정의와 공정성, 그리고 기술 만능주의가 가진 함정 같은 근본적인 질문에 대해서는 뚜렷한 해답을 내놓지 않는다.

책을 읽으며 올트먼의 주장에 매료되어, 바로 내 투자 포트폴리오를 점검했다. 기존 테크 주식에 더해 에너지와 생명공학 기업까지 관심이 넓어졌다. 샘 올트먼은 일론 머스크 못지않게 위대한 인물임에도, 대중적으로는 정보가 많지 않다. AI가 머지않아 세상을 바꿀 것 같다면, 이 책을 통해 샘 올트먼의 계획을 이해해보는 것도 나쁘지 않을 것 같다.

생각들

작더라도 끊임없이 아웃풋을 내는 사람이 되어야 한다.

다양한 것을 시도할수록, 새로운 것을 발견할 가능성이 커진다.

나쁜 아이디어를 많이 가져보지 않고서는, 좋은 아이디어도 많이 가질 수 없다.

예상과 다르게 흘러간 일들 대부분은, 어떻게든 되돌릴 수 있다.

반복적인 일을 할 때는, 무엇을 해야한다는 TODO가 아니라 무슨 시간에 무엇을 한다는 Planning을 짜는게 더 좋은 방법 같다. 예를 들어 '아침에 운동하기'보다는 '7:00~8:00 운동', '저녁에 1시간 영어공부'보다는 '21:00~22:00 영어 사용'과 같은 방식

시간에 압박을 받는다는 것은 강제로 낙관주의자가 된다는 뜻이다.(할 수 있다와 해야만 한다는 어떤 면에서는 다르지 않다) 낙관주의는 현실을 형성하기 때문에 시간 압박을 받는 사람은 실제로도 일을 빠르게 해낸다. 시간 압박이 격차를 만든다.

![신간] 이재훈의 '샘 올트먼, 더 비전 2030'… 오픈AI CEO의 청사진, 한국어로 만난다 – AI 매터스 l AI Matters 신간] 이재훈의 '샘 올트먼, 더 비전 2030'… 오픈AI CEO의 청사진, 한국어로 만난다 – AI 매터스 l AI Matters](https://substackcdn.com/image/fetch/$s_!Cai3!,w_1456,c_limit,f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F1f709177-5914-4677-be95-1df5ce4e4933_1312x736.jpeg)